IA e psicoterapia: impatto e sinergia

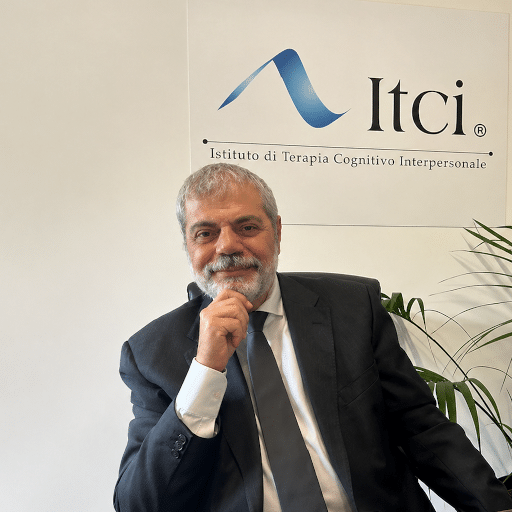

Roberto Milani intervista Tonino Cantelmi

Introduzione

Nell’epoca della trasformazione digitale, la medicina e la psicoterapia si trovano di fronte ad una delle sfide più radicali della loro storia: integrare l’innovazione tecnologica senza smarrire la componente umana della cura. In questo scenario complesso, in cui algoritmi, intelligenza artificiale e sistemi predittivi iniziano ad influenzare diagnosi, decisioni cliniche e relazioni terapeutiche, diventa fondamentale interrogarsi non solo su ciò che sia possibile fare, ma su ciò che sia giusto fare.

A guidarci in questa riflessione è Tonino Cantelmi, psichiatra e psicoterapeuta, da anni impegnato nell’intersezione tra salute mentale, etica ed innovazione. Con un’esperienza che abbraccia la formazione accademica, la pratica clinica ed il contributo nei principali organismi istituzionali e bioetici italiani — tra cui il Comitato Nazionale per la Bioetica e l’Istituto Nazionale per la Salute delle Popolazioni Migranti — Cantelmi rappresenta una delle voci più autorevoli nel dibattito contemporaneo sulla medicina del futuro: assieme a lui esploriamo il delicato equilibrio tra tecnologia ed umanità, il ruolo della relazione terapeutica in un mondo sempre più digitale e le nuove responsabilità a cui sono chiamati medici, psicologi ed istituzioni.

Nel suo lavoro clinico ed istituzionale, quanto sta già incidendo l’intelligenza artificiale sulla pratica della salute mentale, e quali cambiamenti ritiene più significativi nel rapporto tra terapeuta e paziente?

L’intelligenza artificiale sta già avendo un impatto concreto sulla gestione della salute mentale. La relazione tra paziente e terapeuta non è più soltanto a due, ma spesso include anche la tecnologia. Un tempo le persone si rivolgevano a Google per avere suggerimenti; oggi si affidano a una intelligenza artificiale più sofisticata. Questo significa che la tecnologia è ormai entrata anche nella stanza clinica.

Il cambiamento più importante è che il terapeuta deve tenere conto dell’influenza che la tecnologia esercita sulla relazione con il paziente. Può orientare le domande che pone, le sue aspettative, le sue interpretazioni e perfino l’immagine che costruisce di sé.

Tuttavia, credo che l’intelligenza artificiale debba restare uno strumento di supporto e non sostituire la relazione terapeutica. La psicoterapia si fonda sulla presenza, sulla responsabilità, sulla continuità e sull’alleanza tra terapeuta e paziente. Sono dimensioni che un sistema automatizzato non può replicare. L’intelligenza artificiale può essere utile nella psicoeducazione, nel monitoraggio e nell’accompagnamento tra una visita e l’altra, può perfino supportare e integrare la seduta, ma non può occupare il centro della cura, che resta profondamente umano.

Come Istituto, abbiamo sviluppato l’app ITCI Compassion, pensata come supporto al percorso terapeutico, non come sua alternativa. Ritengo infatti fondamentale studiare strumenti appropriati, fondati su evidenze scientifiche e coerenti con il lavoro clinico che si sta svolgendo, e non il contrario. Deve essere la tecnologia a mettersi al servizio della terapia, non la terapia ad adattarsi alle logiche della tecnologia.

Il punto decisivo è che il terapeuta deve conoscere bene e padroneggiare lo strumento che propone al paziente, così da poterlo integrare in modo consapevole nel percorso di cura. Solo in questo modo un’app può diventare un supporto reale: aiutare tra una seduta e l’altra, favorire continuità e allenare alcune competenze. Altrimenti il paziente può costruire interpretazioni di sé, aspettative o convinzioni fuorvianti, che non corrispondono alla sua reale domanda di aiuto né alla necessità clinica del momento.

Da un punto di vista istituzionale, questo è ormai un tema fondamentale, che occupa una parte importante del dibattito e della riflessione etica e scientifica. Il Comitato Nazionale per la Bioetica ha ritenuto essenziale lavorare su questi temi, proprio perché l’ingresso dell’intelligenza artificiale nella cura non è una semplice innovazione tecnica, ma una trasformazione profonda che tocca il consenso informato, la responsabilità clinica e la tutela della dimensione umana della medicina. Il fatto che sia stato dedicato a questo tema un parere specifico mostra bene quanto sia necessario governare questa transizione con grande attenzione.

Lei si occupa anche di bioetica: quali sono, oggi, i principali rischi etici legati all’uso crescente di tecnologie intelligenti in ambito sanitario e psicologico?

Come dicevo, il Comitato Nazionale per la Bioetica ha approvato recentemente un parere specifico su questo tema: “Relazione di cura, consenso informato e responsabilità nell’era dell’Intelligenza Artificiale”, al cui redazione ho contribuito con Alberto Gambino, Giovanni Maga e Carlo Maria Petrini. Il documento affronta molti aspetti cruciali; qui mi soffermo su alcuni tra i più rilevanti, che aiutano a capire dove si concentrano oggi i principali rischi etici.

Inizierei affrontando il tema del consenso informato. Con sistemi sempre più complessi, c’è il rischio che il paziente non comprenda davvero fino in fondo le informazioni che gli vengono fornite. Per questo non basta aggiungere moduli o spiegazioni tecniche: bisogna rendere l’informazione più chiara, più accessibile e più adatta alla persona concreta. Il paziente deve sapere se l’intelligenza artificiale viene utilizzata, quale ruolo svolge e quali limiti ha.

Un altro punto importante riguarda l’autonomia del paziente. L’intelligenza artificiale può aiutare a orientarsi meglio, ma può anche produrre l’effetto opposto se manca una mediazione clinica adeguata. Il paziente rischia di affidarsi troppo a risposte automatiche e di trasformarle in autodiagnosi. In salute mentale questo aspetto è ancora più delicato, perché la relazione personale e l’empatia sono essenziali.

C’è poi il tema della responsabilità. L’intelligenza artificiale rende più complessa la catena delle responsabilità, perché accanto al medico entrano in gioco la struttura sanitaria, chi sviluppa il sistema, chi lo produce e chi lo controlla. Il rischio è duplice: delegare troppo alla macchina o creare una confusione per cui non è più chiaro chi risponde davvero delle decisioni prese. La decisione clinica resta però un atto umano e richiede una responsabilità più chiara e meglio distribuita.

Un altro passaggio fondamentale riguarda la trasparenza. Non basta sapere che un sistema viene usato: bisogna capire su quali dati è stato costruito, entro quali limiti funziona e quali possibili distorsioni può portarsi dietro. Questo è importante anche per prevenire i conflitti di interesse, perché dietro gli algoritmi non ci sono soltanto questioni tecniche, ma anche scelte economiche, industriali e culturali.

Infine, c’è il tema dei dati sanitari e dell’equità. I dati sanitari sono estremamente sensibili e con l’intelligenza artificiale diventano ancora più preziosi, ma anche più esposti. Il consenso resta essenziale, ma da solo può non bastare. La vera sfida etica è progettare tecnologie che siano al servizio di tutti, soprattutto delle persone più vulnerabili. L’intelligenza artificiale può migliorare l’accesso alle cure e renderle più personalizzate, ma può anche accentuare le disuguaglianze se viene costruita su dati distorti o se resta accessibile solo ad alcuni. I bias, infatti, non sono soltanto errori tecnici: spesso riflettono disuguaglianze già presenti nella società.

In sintesi, il rischio etico più grande è confondere l’efficienza con la cura. L’intelligenza artificiale può essere una risorsa preziosa, ma solo se resta dentro una cornice fatta di trasparenza, responsabilità, protezione dei dati, equità, supervisione istituzionale e controllo umano continuo.

In un contesto sempre più digitalizzato, come si può preservare — o addirittura rafforzare — la dimensione umana ed empatica della cura?

Nel mondo di oggi, che definisco post-modernità tecnoliquida, dove tutto è sempre più attraversato dalla tecnologia, è importante ricordare che la cura delle persone deve restare una questione profondamente umana. La tecnologia può essere uno strumento utile, ma non deve sostituire la relazione. Il rapporto tra terapeuta e paziente si fonda sull’ascolto, sulla presenza, sulla responsabilità e sulla capacità di aiutare la persona a dare senso alla propria sofferenza. Sono dimensioni che le macchine, pur potendo simulare l’empatia, non debbono assumere.

Eppure, la tecnologia, se usata bene, può anche rafforzare la cura. Può liberare tempo per ciò che conta davvero, come l’ascolto autentico, e può sostenere la continuità tra una visita e l’altra. Ma questo accade solo se resta sempre una supervisione umana e se il terapeuta mantiene il suo giudizio e la sua responsabilità.

In fondo, la sfida è questa: non soltanto umanizzare artificialmente la macchina, ma custodire l’umanità del curante. La cura resta davvero empatica quando la tecnologia non prende il posto dell’incontro, ma lo protegge, lo sostiene e gli restituisce spazio.

Dal suo osservatorio accademico e formativo, che tipo di competenze dovrebbero sviluppare i futuri psicoterapeuti per affrontare le sfide poste dalle nuove tecnologie?

Nel mese di aprile, con la Consulta delle Scuole di Psicoterapia Cognitivo Comportamentale, di cui sono consigliere nazionale, abbiamo organizzato un convegno intitolato “Intelligenza Artificiale e Psicoterapia” e reso pubblico il “Manifesto sulla salute mentale e l’Intelligenza Artificiale”. Questo manifesto afferma una cosa molto semplice: come scuole di psicoterapia, stiamo lavorando da tempo su questi temi perché il nostro obiettivo è governare il futuro, non essere governati dall’intelligenza artificiale.

Dal punto di vista formativo, credo che i futuri psicoterapeuti debbano sviluppare anzitutto una solida cultura critica della tecnologia. Non è sufficiente saper utilizzare uno strumento: è fondamentale capirne i limiti, i rischi, i bias, gli effetti sulla relazione di cura e le implicazioni etiche e deontologiche. In altre parole, devono imparare a valutare quando una tecnologia può essere utile e quando invece rischia di impoverire il lavoro clinico.

Inoltre, è necessaria una competenza nuova nel tenere insieme clinica e innovazione: saper utilizzare l’intelligenza artificiale come supporto, ma all’interno di una cornice di supervisione umana, responsabilità professionale e centralità della relazione. Il futuro psicoterapeuta dovrà essere sempre più capace di integrare strumenti digitali senza delegare a essi il giudizio clinico.

C’è un punto che considero decisivo: la capacità di custodire ciò che nessuna tecnologia può sostituire, cioè l’ascolto, la mentalizzazione, la lettura della singolarità del paziente, la gestione della complessità relazionale, dell’ambivalenza e della crisi. Più gli strumenti intelligenti entreranno nella clinica, più il terapeuta dovrà essere forte proprio in quelle competenze profondamente umane che fanno la differenza nella cura.

Infine, dovranno crescere anche competenze di trasparenza e alfabetizzazione: saper spiegare al paziente che cosa fa la tecnologia, che cosa non fa, quali dati utilizza e quali limiti ha. In altre parole, il futuro psicoterapeuta non dovrà essere solo un buon clinico, ma anche un professionista capace di orientarsi responsabilmente nell’ecosistema digitale senza perdere il cuore relazionale della psicoterapia.

Guardando al futuro, quale modello di medicina e di relazione terapeutica immagina nei prossimi 10–15 anni: più tecnologico, più umano, o necessariamente una sintesi dei due?

Questa è forse la domanda più difficile, perché la tecnologia avanza a una velocità tale che ogni previsione rischia di essere presto superata. Già tra un anno molte delle categorie che oggi utilizziamo per comprendere questi processi potrebbero non bastare più. L’innovazione, infatti, alza continuamente il livello della sfida e rende tutto più rapido, più pervasivo e più complesso.

Nei prossimi 10-15 anni non credo che la medicina diventerà semplicemente più tecnologica o semplicemente più umana. Sarà inevitabilmente una sintesi delle due dimensioni. La vera domanda, però, è chi guiderà questa sintesi.

Per me, il punto decisivo è che l’uomo deve custodire e difendere ciò che lo rende davvero umano: l’ascolto, la capacità di comprendere, il senso della responsabilità, la vicinanza a chi soffre, la disponibilità a reggere l’incertezza e il riconoscimento dell’unicità di ogni persona. La tecnologia può essere un aiuto prezioso, ma solo se viene progettata e utilizzata in modo da sostenere la relazione di cura e non da prenderne il posto. Per questo parlerei di una necessaria umanizzazione della tecnologia: un uso dell’intelligenza artificiale che sappia preservare, e non indebolire, ciò che è propriamente umano.

Se ben governata, la tecnologia può diventare una forma di intelligenza aumentata: può migliorare l’accuratezza, alleggerire i compiti ripetitivi, ampliare l’accesso alle cure, sostenere la continuità terapeutica. Ma tutto questo ha valore solo se resta saldo il primato della persona e della relazione. Quando la macchina pretende di occupare il centro della cura, non siamo più davanti a un progresso, ma a un impoverimento.

Immagino quindi una medicina molto più tecnologica di oggi, ma proprio per questo chiamata a essere ancora più umana. La sfida del futuro non sarà scegliere tra tecnologia e umanità, ma far sì che la tecnologia resti dentro un orizzonte etico capace di custodire la dignità della persona.